AI가 만든 음악을 구별할 수 있을까 — 우리의 여정

Suno에서 곡 하나를 뽑아봤다. 3분짜리 팝송. 꽤 괜찮았다. 코러스도 있고 브릿지도 있고, 어레인지도 나름 세련됐다. 솔직히 말하면 — 이게 AI가 만든 건지 사람이 만든 건지, 그냥 들어서는 모르겠더라.

여기서부터 우리 이야기가 시작된다.

처음에 던진 질문

사람이 만든 음악과 AI가 만든 음악은 뭐가 다를까? 이걸 진지하게 고민해본 적 있는 사람은 많지 않을 것 같다. 우리도 처음엔 막연했다.

"음색이 다르지 않을까?" "믹싱 퀄리티가 낮지 않을까?" — 이런 직관적인 추측들을 해봤는데, 요즘 생성 AI는 이런 것들도 꽤 잘 한다. 표면적인 차이로는 안 된다.

그러다 한 가지 가설이 떠올랐다. 구조. 사람이 만든 음악은 곡 전체에 걸친 흐름이 있다. 인트로에서 빌드업을 만들고, 벌스에서 이야기를 쌓고, 코러스에서 터뜨린다. 이 거시적인 흐름을 AI도 정말 잘 만들까?

4마디라는 단위

음악에는 마디라는 개념이 있다. 대중음악에서는 보통 4마디가 하나의 프레이즈를 이룬다. 우리는 이걸 "세그먼트"라고 부르기로 했다. 곡을 4마디씩 잘라서 보면, 각 조각이 곡 전체에서 어떤 역할을 하는지가 보인다.

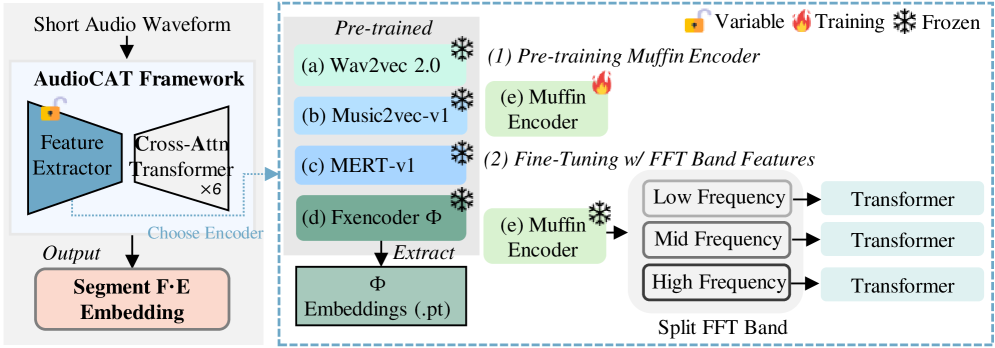

이 아이디어가 맞는지 확인해보고 싶었다. 비트 트래킹으로 다운비트를 찾고, 4마디 단위로 곡을 나눠봤다. 그리고 세그먼트별로 특징을 뽑아서 비교했다.

결과가 흥미로웠다. 사람이 만든 음악은 세그먼트 간의 관계가 명확했다. A 파트와 B 파트가 대조되고, 코러스가 반복될 때 미세한 변화가 있고. 반면에 AI 음악은 각 세그먼트가 그 자체로는 괜찮은데, 세그먼트들끼리의 관계가 좀 약했다.

두 개의 시선

여기서 고민이 생겼다. 세그먼트 하나만 봐도 AI인지 알 수 있는 경우가 있고, 곡 전체 구조를 봐야 알 수 있는 경우가 있다. 둘 다 잡아야 했다.

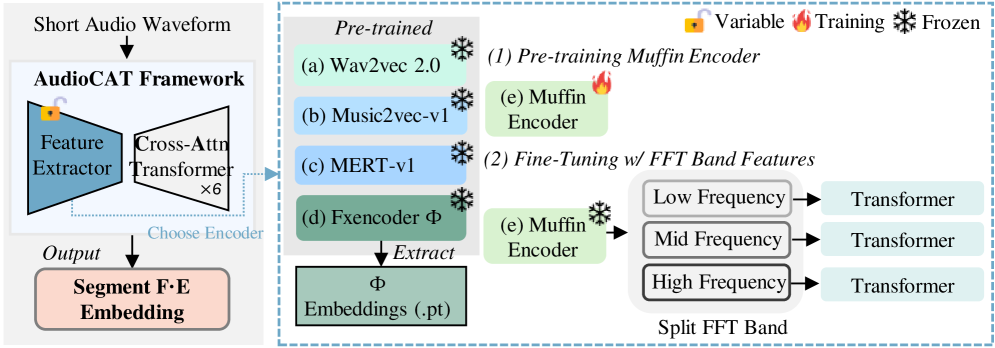

그래서 모델을 두 단계로 나눴다. 첫 번째 단계에서는 각 세그먼트의 "콘텐츠"를 본다 — 음색, 멜로디, 리듬 같은 것들. 두 번째 단계에서는 세그먼트들을 쭉 나열해놓고 곡 전체의 "구조"를 본다.

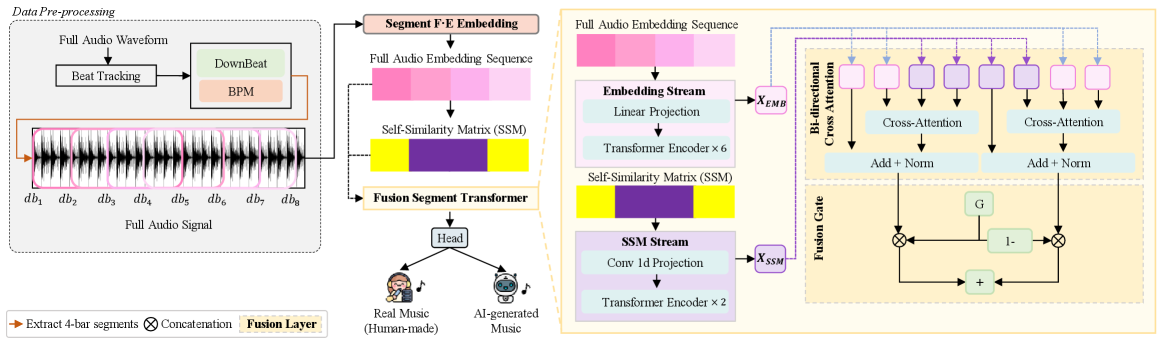

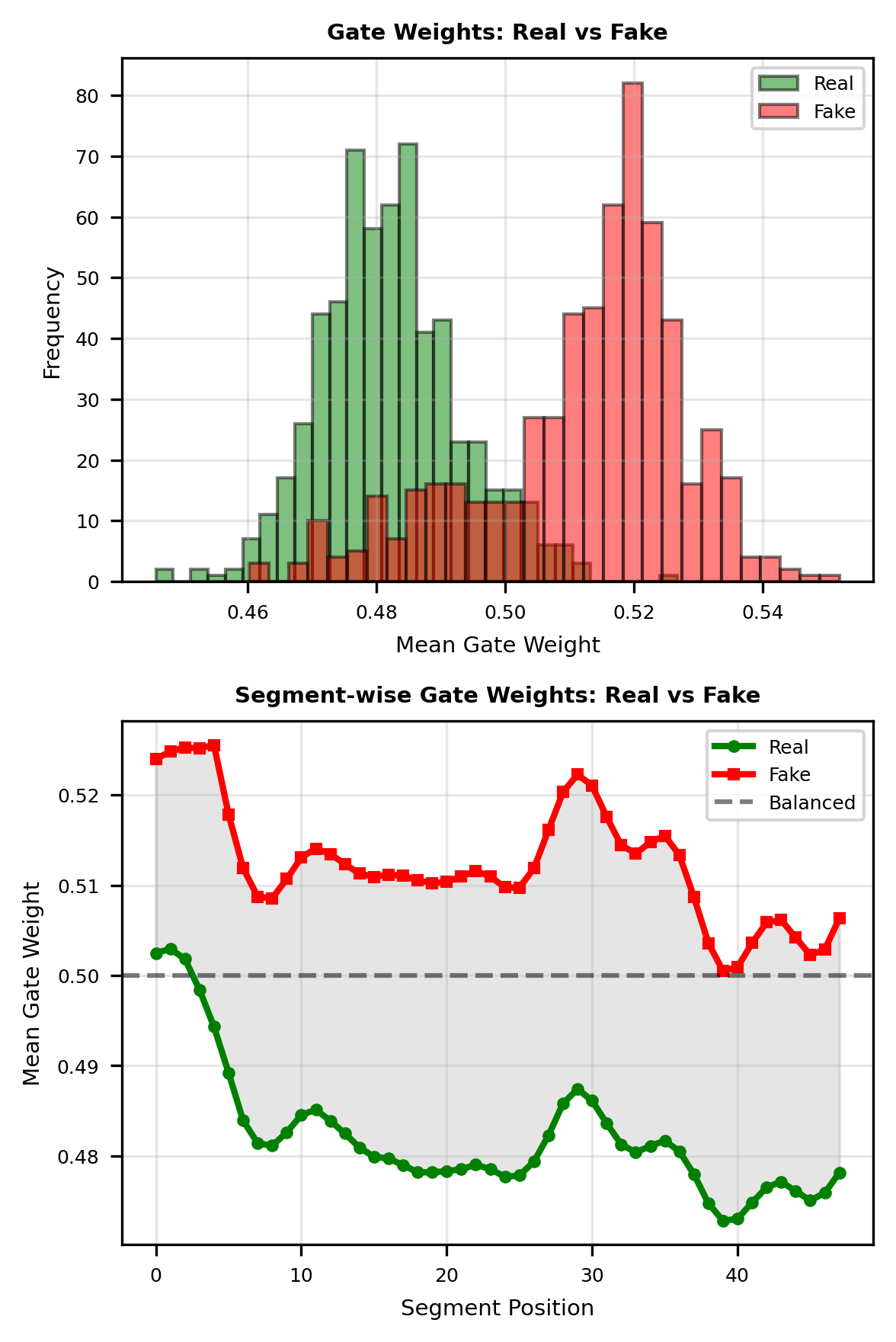

재밌는 걸 발견했다. 모델이 "이건 사람이 만든 곡이야"라고 판단할 때는 주로 구조적인 특징에 의존했고, "이건 AI야"라고 판단할 때는 콘텐츠 쪽 특징을 더 많이 봤다. 사람 음악의 강점은 구조에 있고, AI 음악의 약점도 구조에 있다는 뜻이었다.

앞으로 발전시키고 싶은 것들

이 연구를 하면서 오히려 해보고 싶은 게 더 많아졌다. AI 음악 생성 기술은 계속 진화하고 있고, 그만큼 우리 모델도 함께 성장할 여지가 크다.

음악을 단순히 오디오 신호로 보는 게 아니라, 구조를 가진 하나의 작품으로 보는 것. 이 관점은 AI 탐지뿐 아니라 음악을 이해하는 더 넓은 문제에도 적용할 수 있을 거라 생각한다. 더 다양한 장르, 더 최신 AI 모델들, 그리고 실시간 서비스까지 — 확장해나갈 방향이 명확하다는 게 오히려 설렌다.

글 · 김유민 (MIPPIA Research)